Les 10 Critères SEO Essentiels pour Dominer Google en 2026

Votre site reçoit moins de 10 visiteurs par jour. Pourtant, vos concurrents cartonnent avec un contenu similaire. La différence ne tient pas à la chance, mais à la maîtrise des critères SEO que Google utilise pour décider qui mérite la première page. Erreur classique : croire qu’il suffit de « créer du contenu de qualité ». En réalité, Google analyse plus de 200 signaux de classement, et ignorer les plus critiques condamne votre site à l’invisibilité.

Ce guide révèle les critères de positionnement SEO qui influencent réellement votre classement en 2026. Vous découvrirez les trois piliers fondamentaux, les facteurs techniques souvent négligés, et surtout les erreurs qui tuent votre référencement naturel sans que vous le sachiez.

En Bref

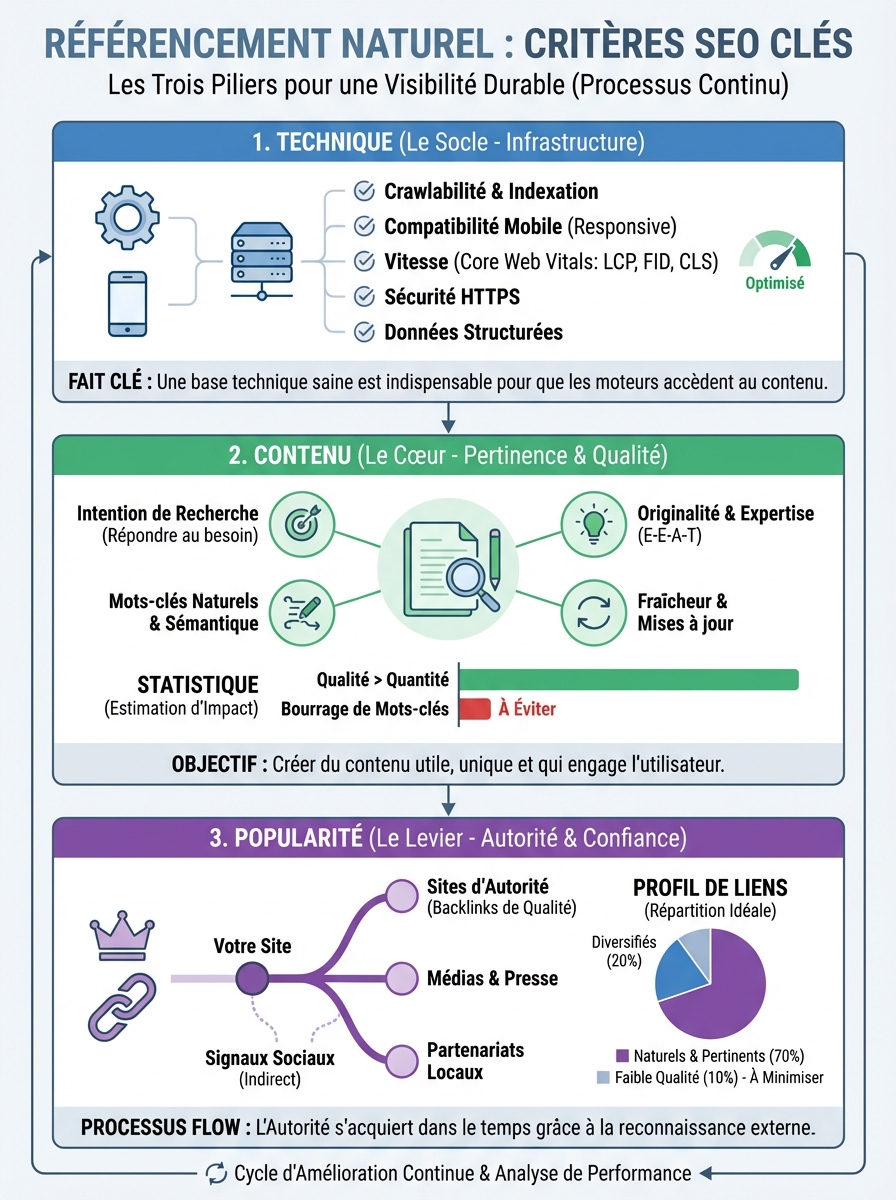

- Le SEO repose sur trois piliers : technique, contenu, popularité

- Google privilégie l’intention utilisateur sur la densité de mots-clés

- Les Core Web Vitals impactent directement le classement depuis 2021

- Un bon contenu sans backlinks reste invisible, un site rapide sans contenu ne convertit pas

- L’expertise (E-E-A-T) devient déterminante pour les sujets sensibles

Qu’est-ce que le Référencement Naturel SEO et Pourquoi C’est Crucial

Définition du SEO et son évolution depuis 2010

Le référencement naturel (Search Engine Optimization) désigne l’ensemble des techniques visant à positionner un site dans les résultats organiques des moteurs de recherche. Contrairement aux idées reçues, il ne s’agit pas de « tromper » Google, mais de répondre aux critères que l’algorithme juge pertinents pour l’utilisateur.

En 2010, bourrer une page de mots-clés suffisait pour ranker. Google Panda (2011) puis Penguin (2012) ont détruit cette approche. Aujourd’hui, l’algorithme évalue la satisfaction utilisateur : un site qui répond à l’intention de recherche gagne, peu importe sa densité de mots-clés.

L’évolution majeure : Google utilise désormais l’apprentissage automatique (RankBrain depuis 2015, puis MUM en 2021) pour comprendre le contexte et l’intention derrière chaque requête. Une page optimisée pour « meilleur restaurant Paris » doit traiter l’intention informationnelle (lire des avis) différemment de l’intention transactionnelle (réserver une table).

Impact du référencement naturel sur la visibilité online

Le référencement naturel représente la source de trafic la plus rentable sur le long terme. Contrairement aux publicités payantes, un bon positionnement génère du trafic sans coût marginal supplémentaire.

Observation terrain : les sites en première position captent environ 28% des clics, la deuxième position 15%, la troisième 11%. Passer de la page 2 à la position 3 peut multiplier votre trafic par 10. C’est la raison pour laquelle des entreprises investissent massivement dans le SEO : le coût d’acquisition client via le référencement naturel reste inférieur à celui des publicités sur la durée.

Erreur fréquente : croire que le SEO est « gratuit ». Vous payez en temps, expertise et parfois outils. Mais contrairement à Google Ads où arrêter les dépenses stoppe le trafic, un bon référencement continue de générer des visites pendant des mois, voire des années.

SEO vs SEM : quelles différences en 2026 ?

Le SEM (Search Engine Marketing) englobe toutes les actions sur les moteurs de recherche : SEO (résultats organiques) + SEA (publicités payantes type Google Ads). La confusion persiste car beaucoup utilisent SEM comme synonyme de SEA.

Différence clé en 2026 : le SEO exige du temps (3 à 6 mois pour observer des résultats) mais génère un trafic durable. Le SEA produit des résultats immédiats mais coûte à chaque clic. Une stratégie gagnante combine les deux : SEA pour tester rapidement des mots-clés, SEO pour pérenniser les performances.

Biais psychologique : les utilisateurs font davantage confiance aux résultats organiques qu’aux annonces. Certaines études montrent que les internautes évitent consciemment les résultats marqués « Annonce », même s’ils apparaissent en premier.

Les Trois Piliers Fondamentaux du Référencement Naturel

Pour comprendre comment un guide complet du référencement naturel SEO structure sa stratégie, il faut maîtriser les trois piliers qui soutiennent tout le système.

Le pilier technique : architecture et indexabilité du site

Le pilier technique concerne tout ce qui permet à Google de crawler, indexer et comprendre votre site. Sans fondations techniques solides, même le meilleur contenu reste invisible.

Élément critique souvent négligé : le fichier robots.txt. Une seule ligne mal configurée peut bloquer l’indexation de tout votre site. Cas réel : un site e-commerce a perdu 70% de son trafic en 48h après une mise à jour qui ajoutait accidentellement `Disallow: /` dans le robots.txt.

Les aspects techniques incluent : vitesse de chargement, compatibilité mobile, structure d’URLs, plan de site XML, balises canoniques, données structurées (Schema.org). Chaque élément envoie des signaux à Google sur la qualité et la fiabilité de votre site.

Le pilier contenu : qualité, pertinence et satisfaction utilisateur

Le contenu reste le cœur du référencement naturel. Mais « contenu de qualité » ne signifie pas « long article bourré de mots-clés ». Google évalue si votre contenu répond à l’intention de recherche de l’utilisateur.

Contradiction fréquente : beaucoup créent du contenu optimisé pour Google, pas pour l’humain. Résultat : un texte artificiel que personne ne lit jusqu’au bout. Google détecte ce comportement via les signaux utilisateur (taux de rebond élevé, temps de visite faible) et pénalise le classement.

Le contenu doit traiter le sujet en profondeur, structurer l’information clairement (titres Hn logiques), et apporter une valeur unique. Copier-coller ou paraphraser des concurrents ne suffit plus : Google privilégie les contenus qui apportent un angle nouveau ou une expertise vérifiable.

Le pilier popularité : backlinks, signaux sociaux et autorité de domaine

Le pilier popularité mesure la confiance et l’autorité de votre site aux yeux de Google. Le principal indicateur : les backlinks (liens entrants depuis d’autres sites).

Principe fondamental : un lien d’un site autoritaire vaut plus que 100 liens de sites spam. Google considère chaque backlink comme un « vote de confiance ». Mais tous les votes ne se valent pas : un lien depuis un site gouvernemental (.gouv) ou universitaire (.edu) pèse beaucoup plus qu’un lien depuis un annuaire généraliste.

Erreur critique : acheter des backlinks en masse sur des plateformes low-cost. Google détecte ces schémas et applique des pénalités manuelles ou algorithmiques. Résultat : votre site disparaît des résultats du jour au lendemain. La récupération peut prendre des mois, voire des années.

En Bref

- Technique : assure que Google peut accéder et comprendre votre site

- Contenu : répond précisément à l’intention de recherche de l’utilisateur

- Popularité : démontre que d’autres sites vous considèrent comme référence

- Aucun pilier ne suffit seul, les trois doivent être équilibrés

Critères Techniques SEO : L’Architecture du Succès

Vitesse de chargement et Core Web Vitals (LCP, FID, CLS)

Depuis la mise à jour Page Experience (2021), Google intègre les Core Web Vitals comme facteur de classement officiel. Ces métriques mesurent l’expérience utilisateur réelle : vitesse de chargement, interactivité, stabilité visuelle.

Les trois métriques clés :

- LCP (Largest Contentful Paint) : temps avant affichage du plus gros élément visible (idéal : < 2,5s)

- FID (First Input Delay) : délai avant que le site réponde à la première interaction (idéal : < 100ms)

- CLS (Cumulative Layout Shift) : stabilité du contenu pendant le chargement (idéal : < 0,1)

Observation terrain : un site qui passe de 5 secondes à 2 secondes de chargement peut voir son taux de conversion augmenter de 50% ou plus. Chaque seconde supplémentaire augmente le taux de rebond de manière significative.

Erreur technique fréquente : optimiser uniquement la page d’accueil. Google évalue chaque page individuellement. Un blog rapide avec une page produit lente perdra du trafic sur les pages commerciales.

Crawlabilité, indexabilité et structure du site

La crawlabilité désigne la capacité de Google à parcourir votre site. L’indexabilité concerne la possibilité d’inclure vos pages dans l’index Google. Sans ces deux éléments, vous n’existez pas pour le moteur de recherche.

Problème sous-estimé : le budget de crawl. Google alloue un temps limité à chaque site selon son autorité. Si votre site contient 10 000 pages mais que Google n’en crawle que 100 par jour, il faudra 100 jours pour parcourir tout le site. Pendant ce temps, vos nouvelles pages restent invisibles.

Solutions techniques :

- Fichier robots.txt bien configuré pour diriger les robots vers les pages importantes

- Plan de site XML à jour, soumis via Google Search Console

- Structure d’URLs logique et peu profonde (idéal : 3 clics maximum depuis l’accueil)

- Balises canonical pour éviter le duplicate content

- Redirections 301 propres sans chaînes ni boucles

Cas d’échec : un site avec des milliers de pages filtrées (ex : e-commerce avec filtres couleur, taille, prix) gaspille son budget de crawl sur des pages quasi-identiques. Résultat : les pages produits importantes ne sont pas crawlées régulièrement.

Architecture responsive, mobile-first et optimisation UX

Depuis 2019, Google applique l’indexation mobile-first : il analyse d’abord la version mobile de votre site, même pour le classement desktop. Un site non optimisé mobile perd automatiquement du classement.

L’architecture responsive ne suffit plus. Google évalue l’expérience utilisateur mobile : taille des boutons tactiles, espacement, lisibilité du texte sans zoom, absence de pop-ups intrusifs.

Pièges UX qui nuient au SEO :

- Pop-ups plein écran sur mobile (Google pénalise depuis 2017)

- Boutons trop petits ou trop proches (difficiles à cliquer au doigt)

- Contenu masqué derrière des onglets ou accordéons (Google peut ne pas l’indexer)

- Vidéos auto-play qui consomment la data mobile

Contradiction fréquente : certains sites cachent du contenu sur mobile pour « améliorer l’UX ». Google peut interpréter cela comme du cloaking (contenu différent selon l’appareil) et pénaliser le site.

Optimisation du Contenu : Pertinence et Intention de Recherche

Stratégie de mots-clés et densité optimale en 2026

La densité de mots-clés (pourcentage d’apparitions dans le texte) n’est plus un critère pertinent depuis les mises à jour Hummingbird (2013) et RankBrain (2015). Google comprend désormais le contexte sémantique.

Approche moderne : travailler des champs sémantiques plutôt que répéter un mot-clé. Pour « voyage en Espagne », Google attend aussi « Madrid », « Barcelone », « itinéraire », « budget », « meilleure période », etc. L’absence de ces termes signale un contenu superficiel.

Erreur classique : optimiser pour un seul mot-clé par page. En réalité, une page bien optimisée peut ranker sur des dizaines, voire des centaines de requêtes longue traîne. Un article sur « choisir son matelas » peut aussi ressortir sur « matelas mal de dos », « matelas pour dormir sur le côté », etc.

Stratégie à forte valeur : analyser les questions PAA (People Also Ask) de Google pour le mot-clé cible. Ces questions révèlent l’intention de recherche et les sous-sujets attendus. Intégrer ces réponses dans votre contenu augmente les chances de ranker sur plusieurs requêtes.

Structure du contenu et balisage H1-H6 pour le SEO

La hiérarchie des titres (H1 à H6) structure votre contenu pour Google ET pour l’utilisateur. Une structure logique facilite la compréhension et améliore le classement.

Règles d’or :

- Un seul H1 par page (le titre principal), contenant le mot-clé principal

- Les H2 structurent les sections principales

- Les H3 à H6 créent des sous-sections logiques

- Chaque titre doit décrire précisément le contenu qui suit

Erreur technique fréquente : sauter des niveaux (passer de H2 à H4). Google interprète cela comme une structure illogique. Respecter la hiérarchie renforce la cohérence sémantique.

Observation terrain : les pages avec une structure Hn claire obtiennent plus de featured snippets (position 0). Google extrait facilement les réponses grâce aux balises H2/H3 qui correspondent aux questions PAA.

Longueur du contenu, profondeur et satisfaction de l’intention

Mythe persistant : « plus c’est long, mieux c’est ». Faux. Google privilégie la satisfaction de l’intention, pas le nombre de mots.

Exemple concret : une requête « heure Paris » nécessite 5 mots de réponse. Un article de 2000 mots ne rankera jamais face à un snippet direct. À l’inverse, « comment créer une entreprise » demande un guide complet de plusieurs milliers de mots.

Méthodologie efficace :

- Analyser les 10 premiers résultats pour votre mot-clé cible

- Identifier les sujets couverts et les questions traitées

- Créer un contenu qui couvre TOUT ce que vos concurrents traitent + une valeur unique

- Aller plus en profondeur sur au moins un aspect (expertise, cas pratique, données exclusives)

Erreur de débutant : créer un article généraliste sur un sujet très concurrentiel. Sur « marketing digital », impossible de rivaliser avec Wikipédia ou les grandes agences. Meilleur angle : traiter une sous-niche précise (« marketing digital pour artisans du bâtiment ») où la concurrence est plus faible.

Pour approfondir cette dimension stratégique, consultez notre guide sur les 5 piliers essentiels du référencement naturel qui détaille comment structurer un contenu qui convertit.

Les Backlinks et l’Autorité de Domaine : La Popularité en 2026

Stratégie de netlinking et acquisition de backlinks de qualité

Le netlinking (acquisition de liens entrants) reste l’un des trois facteurs les plus importants du classement Google. Mais la quantité ne compte plus : un lien toxique peut détruire votre référencement.

Méthodes d’acquisition légitimes :

- Création de contenu référence (études originales, infographies, guides experts) qui attirent naturellement les liens

- Guest blogging sur des sites thématiquement proches (éviter les fermes à articles)

- Relations presse digitales pour obtenir des mentions dans des médias

- Broken link building : identifier les liens cassés chez vos concurrents et proposer votre contenu en remplacement

Erreur coûteuse : acheter des packs de backlinks sur Fiverr ou 5euros.com. Ces liens proviennent de réseaux de sites (PBN) que Google détecte facilement. Pénalité garantie.

Observation terrain : un seul backlink depuis un site d’autorité (ex : journal national, site gouvernemental) peut avoir plus d’impact que 100 liens de blogs généralistes. La pertinence thématique compte autant que l’autorité.

Pertinence des pages liantes et contexte d’insertion du lien

Google évalue non seulement le domaine source, mais aussi la page précise qui contient le lien et le contexte autour du lien.

Critères d’évaluation :

- Pertinence thématique : un lien depuis un article sur le jardinage vers un site de jardinage vaut plus qu’un lien depuis un article sur la finance

- Position dans la page : un lien dans le contenu principal vaut plus qu’un lien en footer ou sidebar

- Contexte sémantique : le texte autour du lien doit être cohérent avec le sujet de la page cible

- Autorité de la page source : une page déjà bien classée transmet plus de « jus SEO »

Piège sous-estimé : obtenir des liens depuis des pages « partenaires » ou « liens utiles » sans contexte. Google considère ces liens comme moins naturels qu’un lien contextuel dans un article.

Cas pratique : préférer un lien dans un article de blog thématique (même si le domaine a une autorité moyenne) plutôt qu’un lien dans un annuaire généraliste de haute autorité. Le contexte et la pertinence l’emportent.

Texte d’ancrage, autorité de domaine et Page Rank

Le texte d’ancrage (anchor text) indique à Google le sujet de la page cible. Mais une sur-optimisation déclenche des pénalités.

Répartition idéale des ancres :

- 30-40% : ancres de marque (« MonSite », « MonSite.com »)

- 20-30% : ancres génériques (« cliquez ici », « ce site », « en savoir plus »)

- 20-30% : ancres partielles (« guide de jardinage de MonSite »)

- 10-20% : ancres exactes (« meilleur outil jardinage »)

- 10-20% : URLs nues (https://monsite.com)

Erreur fatale : obtenir 100 backlinks avec l’ancre exacte « meilleur avocat Paris ». Google interprète cela comme une manipulation et applique une pénalité Penguin. Votre site disparaît pour cette requête.

Le PageRank (bien que non public depuis 2016) reste un algorithme interne de Google. Il mesure la transmission d’autorité via les liens. Un lien depuis une page avec beaucoup de liens entrants ET peu de liens sortants transmet plus d’autorité.

Détection et élimination des backlinks toxiques

Les backlinks toxiques proviennent de sites spam, PBN (Private Blog Networks), annuaires de mauvaise qualité, sites hackés, ou sites pénalisés. Ils peuvent déclencher une pénalité manuelle ou algorithmique.

Signaux d’alerte :

- Pic soudain de backlinks en quelques jours (probable spam)

- Liens depuis des sites dans des langues étrangères sans rapport avec votre activité

- Ancres sur-optimisées identiques en masse

- Liens depuis des sites sans trafic et créés récemment

Procédure de nettoyage :

- Audit complet des backlinks via Google Search Console ou des outils SEO professionnels

- Identifier les liens suspects (spam score élevé, sites pénalisés)

- Tenter de contacter les webmasters pour retrait manuel (rarement efficace)

- Utiliser l’outil de désaveu Google (Disavow Tool) pour indiquer à Google d’ignorer ces liens

Attention : le désaveu mal utilisé peut nuire. Ne désavouer que les liens clairement toxiques, jamais des liens de faible qualité mais légitimes.

Signaux UX et Comportement Utilisateur : Le Nouvel Or du SEO

Taux de clic (CTR) et positionnement dans les résultats

Le CTR (Click-Through Rate) mesure le pourcentage de clics par rapport aux impressions dans les résultats de recherche. Google l’utilise comme signal de pertinence : si votre page en position 3 reçoit plus de clics que la position 1, Google peut vous remonter.

Facteurs qui influencent le CTR :

- Titre optimisé : inclure le mot-clé + élément différenciant (chiffres, année, bénéfice)

- Meta description convaincante : expliquer clairement ce que l’utilisateur trouvera (même si Google la réécrit parfois)

- URL claire : préférer /guide-seo-2026/ à /page?id=12345

- Rich snippets : étoiles d’avis, FAQ, prix, dates, etc.

Observation terrain : ajouter l’année en cours dans le titre (« Guide SEO 2026 ») peut augmenter le CTR de 20% ou plus. Les utilisateurs cherchent de l’information à jour.

Biais psychologique : les titres avec chiffres impairs (« 7 erreurs SEO ») performent mieux que les chiffres pairs (« 8 erreurs SEO »). Les chiffres ronds comme « 10 » ou « 100 » fonctionnent aussi bien.

Temps de visite (dwell time) et taux de rebond

Le dwell time (temps passé sur la page avant de retourner aux résultats) signale la satisfaction utilisateur. Un temps court indique que le contenu ne répond pas à l’intention.

Le taux de rebond (pourcentage de visiteurs qui quittent sans interagir) doit être interprété avec contexte. Un taux de rebond élevé n’est pas toujours mauvais : si l’utilisateur trouve immédiatement sa réponse, il peut partir satisfait.

Différence clé :

- Dwell time court + retour aux résultats = mauvais signal (contenu non pertinent)

- Taux de rebond élevé + temps de visite long = bon signal (réponse trouvée rapidement)

Techniques pour améliorer l’engagement :

- Intro accrocheuse qui promets une solution claire

- Structure scannale : titres, listes, paragraphes courts

- Éléments visuels : images, schémas, vidéos intégrées

- Liens internes pertinents vers du contenu complémentaire

- FAQ qui répond aux questions secondaires

Erreur fréquente : des blocs de texte massifs sans respiration visuelle. L’utilisateur fuit immédiatement, même si le contenu est excellent.

Signaux sociaux et autorité de marque sur les réseaux

Les signaux sociaux (partages, likes, commentaires sur réseaux sociaux) ne sont PAS des facteurs de classement directs. Google l’a confirmé officiellement. Mais ils impactent indirectement le SEO.

Impact indirect :

- Plus de partages = plus de visibilité = plus de chances d’obtenir des backlinks naturels

- Une marque active sur les réseaux gagne en notoriété et en recherches de marque (signal positif)

- Le trafic social peut améliorer les métriques d’engagement (temps de visite, pages vues)

Observation terrain : les contenus viraux sur les réseaux attirent souvent l’attention de blogueurs et journalistes, qui créent ensuite des backlinks. C’est l’effet indirect recherché.

Contradiction fréquente : certains croient qu’acheter des followers ou des likes améliore le SEO. Aucun impact, car Google ne compte pas ces signaux. Pire : cela nuit à votre taux d’engagement réel (beaucoup de followers inactifs = peu d’interactions proportionnelles).

Pour optimiser votre stratégie technique et analytique, découvrez notre comparatif des meilleurs outils SEO qui vous permettront de mesurer précisément ces signaux.

En Bref

- Un CTR supérieur à vos concurrents peut améliorer votre classement

- Le dwell time mesure la satisfaction réelle, pas le temps total sur site

- Les signaux sociaux n’influencent le SEO qu’indirectement via les backlinks

- Optimiser pour l’humain améliore naturellement les métriques UX

Les Signaux de Confiance et E-E-A-T : Crédibilité et Expertise

Experience, Expertise, Authoritativeness, Trustworthiness

Le concept E-E-A-T guide les évaluateurs de qualité Google (Quality Raters) et influence indirectement l’algorithme. Ajout du premier « E » (Experience) en 2022.

Décomposition :

- Experience : l’auteur a-t-il une expérience directe du sujet ? (crucial pour avis produits, recettes, témoignages)

- Expertise : l’auteur possède-t-il les compétences reconnues ? (diplômes, certifications, publications)

- Authoritativeness : le site est-il considéré comme référence dans son domaine ?

- Trustworthiness : le site est-il fiable, transparent, sécurisé ?

Application pratique : un article médical rédigé par un médecin reconnu sur un site de santé établi aura un E-E-A-T maximal. Le même article sur un blog anonyme sans sources aura un E-E-A-T faible.

Erreur sous-estimée : publier du contenu sans auteur identifié. Google ne peut évaluer l’expertise. Ajouter des biographies d’auteurs avec crédentials renforce l’E-E-A-T.

Certification, avis utilisateurs et mentions de marque

Les avis utilisateurs (Google Business Profile, Trustpilot, Avis Vérifiés) renforcent la confiance, particulièrement pour les sites e-commerce et services locaux.

Impact SEO des avis :

- Les étoiles affichées dans les résultats augmentent le CTR (rich snippets)

- Un volume élevé d’avis positifs renforce l’autorité de marque

- Google utilise les avis Google Business Profile comme critère de classement local

Les mentions de marque (citations du nom de marque sans lien) sont désormais considérées comme un signal. Google associe les mentions fréquentes à une marque établie, même sans backlink.

Stratégie d’acquisition :

- Solliciter des avis après chaque transaction (email automatique)

- Répondre à TOUS les avis (positifs et négatifs) pour montrer l’engagement

- Intégrer les avis sur le site via Schema.org pour les afficher dans les résultats

- Surveiller les mentions de marque et transformer celles sans lien en backlinks (contacter l’auteur)

Piège : acheter de faux avis. Google détecte les schémas suspects (pic soudain d’avis 5 étoiles en quelques jours) et peut pénaliser votre profil Google Business.

Sécurité du site, certificat SSL et données structurées

Le certificat SSL (HTTPS) est un facteur de classement confirmé depuis 2014. Un site en HTTP non sécurisé est désavantagé, et Chrome affiche « Non sécurisé » dans la barre d’adresse.

Les données structurées (Schema.org) ne sont pas un facteur de classement direct, mais elles permettent d’obtenir des rich snippets, qui augmentent le CTR et donc le trafic.

Types de Schema.org les plus impactants :

- Article : auteur, date de publication, image principale

- FAQ : affichage des questions/réponses directement dans les résultats

- Product : prix, disponibilité, avis, étoiles

- LocalBusiness : adresse, horaires, téléphone

- Recipe : temps de préparation, calories, étoiles

- HowTo : étapes illustrées pour les tutoriels

Erreur technique : implémenter Schema.org avec des erreurs de syntaxe. Tester systématiquement avec l’outil de test des résultats enrichis de Google. Une implémentation incorrecte n’apporte aucun bénéfice.

Observation terrain : les pages avec Schema FAQ obtiennent souvent un affichage étendu dans les résultats, qui pousse les concurrents plus bas visuellement, même à classement égal.

Contenu YMYL et signaux d’expertise spécialisée

Les sujets YMYL (Your Money Your Life) incluent santé, finance, juridique, sécurité. Google applique des standards E-E-A-T beaucoup plus stricts pour ces thématiques.

Exigences renforcées pour YMYL :

- Auteurs identifiés avec crédentials vérifiables (médecin, avocat, conseiller financier)

- Sources citées pour chaque affirmation factuelle

- Transparence totale : mentions légales, politique de confidentialité, contact

- Avis externes et réputation de l’auteur/site

Cas d’échec : de nombreux sites de santé « alternatifs » ont perdu 80-90% de leur trafic lors des mises à jour Medic (2018) et suivantes. Google a privilégié les sites médicaux officiels, universités, hôpitaux.

Stratégie pour YMYL :

- Collaborer avec des experts reconnus qui signent les articles

- Citer systématiquement des sources officielles (études publiées, organismes reconnus)

- Ajouter des disclaimers appropriés (« cet article ne remplace pas un avis médical »)

- Obtenir des backlinks depuis des sites d’autorité dans le domaine

Contradiction : certains pensent qu’ajouter « consulter un professionnel » suffit. Non. Google évalue l’auteur ET le contenu. Un article médical sans expertise démontrée ne rankera pas, même avec disclaimers.

Tableau Synthèse : Critères SEO par Impact et Difficulté

| Critère SEO | Impact sur Classement | Difficulté de Mise en Œuvre | Temps de Résultat | Priorité |

|---|---|---|---|---|

| Backlinks qualité | ⭐⭐⭐⭐⭐ Très élevé | 🔴 Difficile | 3-6 mois | Critique |

| Intention de recherche | ⭐⭐⭐⭐⭐ Très élevé | 🟡 Moyen | 1-3 mois | Critique |

| Core Web Vitals | ⭐⭐⭐⭐ Élevé | 🔴 Difficile | 1-2 semaines | Haute |

| Contenu profondeur | ⭐⭐⭐⭐ Élevé | 🟡 Moyen | 1-3 mois | Haute |

| HTTPS/SSL | ⭐⭐⭐ Moyen | 🟢 Facile | Immédiat | Haute |

| Mobile-friendly | ⭐⭐⭐⭐ Élevé | 🟡 Moyen | 1-2 semaines | Haute |

| Balises Title/Meta | ⭐⭐⭐ Moyen | 🟢 Facile | 1-2 semaines | Moyenne |

| Structure Hn | ⭐⭐⭐ Moyen | 🟢 Facile | 1-2 semaines | Moyenne |

| Schema.org | ⭐⭐ Faible | 🟡 Moyen | 1-2 semaines | Moyenne |

| E-E-A-T | ⭐⭐⭐⭐ Élevé (YMYL) | 🔴 Difficile | 6-12 mois | Variable |

| CTR optimisation | ⭐⭐⭐ Moyen | 🟢 Facile | 1-2 semaines | Moyenne |

| Liens internes | ⭐⭐⭐ Moyen | 🟢 Facile | 1 mois | Moyenne |

Pourquoi Cette Méthode Peut Échouer : Limites et Erreurs Critiques

L’illusion de la checklist complète

Erreur fondamentale : croire qu’appliquer mécaniquement tous les critères SEO garantit le succès. En réalité, Google privilégie l’intention et l’expérience utilisateur sur l’optimisation technique parfaite.

Cas d’échec réel : sites sur-optimisés avec tous les critères cochés, mais contenu creux qui ne répond pas vraiment à la question de l’utilisateur. Résultat : classement médiocre malgré une « perfection » technique.

La vraie approche : commencer par créer du contenu qui satisfait réellement l’utilisateur, PUIS optimiser techniquement. L’inverse (optimiser une coquille vide) ne fonctionne plus depuis 2015.

La sur-optimisation qui déclenche des pénalités

Paradoxe SEO : trop optimiser peut nuire. Google détecte les schémas de manipulation et applique des pénalités algorithmiques.

Signaux de sur-optimisation :

- Densité de mots-clés anormalement élevée (bourrage)

- Ancres de backlinks trop optimisées (90%+ ancres exactes)

- Contenu créé uniquement pour SEO, illisible pour l’humain

- Texte caché, cloaking, redirections trompeuses

Observation terrain : après chaque mise à jour Google, des sites « parfaitement optimisés » s’effondrent tandis que des sites « imparfaits » mais authentiques progressent.

Principe de sécurité : optimiser jusqu’à 80%, pas 100%. Laisser un aspect « naturel » réduit les risques de pénalité.

L’obsession des métriques au détriment du business

Erreur business : optimiser pour des métriques SEO sans lien avec la rentabilité. Exemple : ranker #1 sur un mot-clé qui génère du trafic mais zéro conversion.

Hiérarchie correcte :

- Identifier les mots-clés qui convertissent (intention commerciale)

- Optimiser ces pages en priorité

- Mesurer le ROI (temps investi vs revenus générés)

- Délaisser les mots-clés à fort trafic mais faible valeur commerciale

Cas concret : un site e-commerce ranke #1 sur « histoire de la chaussure » (10 000 visites/mois, 0 vente) mais position 15 sur « acheter chaussures running femme » (500 visites/mois, 50 ventes). Investir sur le second mot-clé génère 100x plus de revenus.

Biais psychologique : la vanité des métriques. Se concentrer sur les positions et le trafic plutôt que sur les conversions et le chiffre d’affaires.

Les délais sous-estimés et l’abandon prématuré

Le SEO exige 3 à 6 mois minimum avant des résultats visibles. Erreur fatale : abandonner après 6 semaines sans progression.

Réalité des délais :

- 1-2 mois : indexation et premières données

- 3-4 mois : début de progression mesurable

- 6-12 mois : résultats significatifs

- 12-24 mois : ROI maximal et trafic stable

Variables qui allongent les délais :

- Domaine neuf (vs domaine établi avec historique)

- Secteur très concurrentiel

- Site sans autorité initiale

- Pénalités passées à rattraper

Stratégie réaliste : combiner SEO (long terme) + SEA (court terme) pendant les 6 premiers mois. Le SEA génère du trafic immédiat pendant que le SEO se construit.

L’oubli de la maintenance continue

Illusion : croire qu’un bon classement est acquis définitivement. En réalité, le SEO nécessite une maintenance constante.

Facteurs de dégradation :

- Concurrents qui améliorent leur contenu

- Mises à jour Google qui changent les critères

- Backlinks qui disparaissent (sites fermés, pages supprimées)

- Contenu qui devient obsolète

- Problèmes techniques qui apparaissent (liens cassés, lenteurs)

Maintenance minimale recommandée :

- Audit technique trimestriel

- Mise à jour du contenu ancien (rafraîchir les dates, chiffres, exemples)

- Surveillance des backlinks (désaveu des liens toxiques)

- Veille concurrentielle mensuelle

- Tests A/B sur titres et meta descriptions

Observation terrain : les sites qui stagnent perdent progressivement des positions, même sans pénalité. Google privilégie le contenu frais et à jour.

Erreurs Fatales à Éviter Absolument

Copier-coller ou spinning de contenu

Google détecte le duplicate content (contenu dupliqué) et choisit une seule version à indexer, généralement l’originale. Votre copie reste invisible.

Le spinning (réécriture automatique via IA ou logiciel) produit un contenu de mauvaise qualité que Google pénalise. Les algorithmes détectent les schémas de reformulation artificielle.

Cas d’échec : certains pensent qu’utiliser ChatGPT ou similaire pour paraphraser des concurrents suffit. Google identifie le contenu sans valeur ajoutée et le classe en bas de page.

Solution : apporter un angle unique. Même sujet que vos concurrents, mais perspective différente, données exclusives, expertise personnelle, exemples originaux.

Négliger la Search Console et ignorer les alertes

Google Search Console signale les problèmes critiques : erreurs d’indexation, pénalités manuelles, problèmes de sécurité, Core Web Vitals.

Erreur courante : ne jamais consulter la Search Console. Résultat : découvrir 6 mois plus tard qu’un fichier robots.txt mal configuré bloque tout le site.

Actions essentielles :

- Configurer les alertes email pour les problèmes critiques

- Consulter le rapport de couverture hebdomadairement

- Surveiller les backlinks et désavouer les liens toxiques

- Analyser les requêtes de recherche pour identifier de nouveaux mots-clés

- Soumettre le sitemap XML après chaque modification importante

Acheter des backlinks ou participer à des réseaux de liens

Les PBN (Private Blog Networks) et l’achat de backlinks violent les guidelines Google. Pénalité manuelle quasi-garantie à moyen terme.

Signaux que Google détecte :

- Croissance anormale de backlinks (100 liens en 1 semaine)

- Liens depuis des sites sans trafic organique

- Footprints communs (même IP, même template, même propriétaire)

- Ancres sur-optimisées identiques

Conséquence : pénalité manuelle nécessitant une demande de réexamen après nettoyage complet. Processus long (3-6 mois), succès non garanti.

Alternative légitime : créer du contenu qui mérite naturellement des liens. Études originales, infographies, outils gratuits, recherches exclusives.

Ignorer l’intention de recherche réelle

Erreur stratégique : cibler un mot-clé à fort volume sans analyser l’intention derrière la requête.

Types d’intention :

- Informationnelle : « comment perdre du poids » → attente d’un guide

- Navigationnelle : « Facebook connexion » → recherche d’une page précise

- Transactionnelle : « acheter iPhone 15 » → intention d’achat immédiat

- Commerciale : « meilleur iPhone 2026 » → comparaison avant achat

Cas d’échec : créer une page produit pour une requête informationnelle. L’utilisateur cherche un guide, trouve une page commerciale, repart immédiatement. Mauvais dwell time = perte de classement.

Méthode d’analyse : taper le mot-clé dans Google et observer les 10 premiers résultats. Si ce sont tous des guides, créez un guide. Si ce sont des pages produits, créez une page produit. Google a déjà déterminé l’intention majoritaire.

Oublier l’optimisation pour la recherche vocale et mobile

La recherche vocale représente une part croissante des requêtes, particulièrement sur mobile. Ces recherches diffèrent des recherches tapées.

Caractéristiques vocales :

- Requêtes plus longues et conversationnelles

- Questions complètes (« quelle est la meilleure pizza près de chez moi »)

- Intention locale fréquente (« près de moi », « ouvert maintenant »)

- Attente de réponses directes et concises

Optimisation vocale :

- Intégrer des questions complètes dans les titres H2/H3

- Créer du contenu FAQ avec réponses courtes (2-3 phrases)

- Optimiser pour la position 0 (featured snippet)

- Utiliser Schema.org FAQ et Speakable

- Renforcer le SEO local (Google Business Profile)

Observation terrain : les contenus optimisés pour la voix gagnent aussi en featured snippets pour la recherche classique. Double bénéfice.

Pour identifier les bons outils de suivi et d’optimisation, notre comparatif Semrush vs Ahrefs vs SE Ranking vous aidera à choisir selon vos besoins spécifiques.

FAQ : Questions Fréquentes sur les Critères SEO

Combien de temps faut-il pour voir des résultats SEO concrets ?

Les premiers résultats apparaissent généralement après 3 à 6 mois d’efforts constants. Les variables incluent l’âge du domaine, la concurrence du secteur, et l’autorité initiale du site.

Un domaine neuf dans un secteur concurrentiel peut nécessiter 12 mois avant d’atteindre la première page. Un site établi qui optimise une page existante peut voir des améliorations en 4-8 semaines.

Stratégie accélérée : combiner SEO et campagnes payantes (SEA) pour générer du trafic immédiat pendant la phase de montée en puissance organique.

Faut-il privilégier le contenu long ou court pour le SEO ?

La longueur optimale dépend entièrement de l’intention de recherche. Une requête informationnelle complexe nécessite du contenu approfondi. Une requête simple attend une réponse directe.

Méthodologie : analyser les 10 premiers résultats pour votre mot-clé cible. Si la moyenne est 2000 mots, créez 2500+ mots avec plus de valeur. Si la moyenne est 500 mots, un article de 3000 mots sera probablement hors-sujet.

Règle pratique : privilégier la profondeur sur la longueur. Un article de 1500 mots qui traite exhaustivement un sujet bat un article de 3000 mots rempli de généralités.

Les réseaux sociaux influencent-ils directement le référencement ?

Non. Google a confirmé que les signaux sociaux (likes, partages, followers) ne sont pas des facteurs de classement directs. Les pages Facebook et Twitter ne sont pas crawlées systématiquement.

Impact indirect réel : le contenu viral sur les réseaux attire l’attention de blogueurs et journalistes qui créent ensuite des backlinks. Ces backlinks influencent le SEO.

Stratégie efficace : utiliser les réseaux pour augmenter la visibilité et déclencher des backlinks naturels, pas pour « améliorer le SEO » directement.

Peut-on faire du SEO sans budget publicitaire ?

Oui, le SEO ne nécessite pas de budget publicitaire, mais demande un investissement temps important. Les actions gratuites incluent création de contenu, optimisation technique basique, netlinking éditorial.

Coûts optionnels qui accélèrent les résultats :

- Outils SEO professionnels (50-200€/mois selon l’outil)

- Rédaction externalisée pour produire plus de contenu

- Développeur pour corrections techniques complexes

- Consultante SEO pour audit et stratégie

ROI typique : un site bien optimisé génère du trafic pendant des années sans coût marginal. Le SEA s’arrête dès que vous coupez le budget.

Quelle différence entre pénalité manuelle et algorithmique ?

La pénalité manuelle résulte d’une action humaine (employé Google qui signale une violation). Elle apparaît dans Google Search Console avec une notification explicite. Récupération possible via demande de réexamen après correction.

La pénalité algorithmique provient d’une mise à jour automatique (Panda, Penguin, Core Updates). Aucune notification. Récupération en corrigeant les problèmes et en attendant la prochaine mise à jour.

Différence critique : la pénalité manuelle peut être levée rapidement (quelques semaines). La pénalité algorithmique nécessite souvent plusieurs mois et une refonte majeure.

Le HTTPS est-il vraiment obligatoire pour bien ranker ?

Le HTTPS (certificat SSL) est un facteur de classement confirmé depuis 2014, mais son poids reste mineur comparé au contenu ou aux backlinks. Un site HTTP peut toujours ranker s’il surpasse ses concurrents sur d’autres critères.

Impact majeur : Chrome affiche « Non sécurisé » pour les sites HTTP, ce qui réduit drastiquement le taux de confiance et augmente le taux de rebond. Impact indirect sur le SEO via les métriques UX.

Recommandation : migrer vers HTTPS est devenu une norme d’hygiène web, pas seulement pour le SEO mais pour la sécurité et la confiance utilisateur. Coût faible (certificat gratuit via Let’s Encrypt).

Conclusion : Prioriser les Critères SEO à Fort Impact

Les critères SEO se comptent par centaines, mais 20% des actions génèrent 80% des résultats. Prioriser l’impact sur l’effort évite la paralysie et accélère les gains.

Hiérarchie d’action recommandée :

Phase 1 (Mois 1-2) : Fondations techniques

- Sécuriser le site (HTTPS)

- Garantir la compatibilité mobile

- Corriger les erreurs de crawl et d’indexation

- Optimiser la vitesse de chargement (Core Web Vitals)

Phase 2 (Mois 3-4) : Contenu et intention

- Analyser l’intention de recherche pour vos mots-clés cibles

- Créer du contenu approfondi qui surpasse les 10 premiers résultats

- Structurer avec balises Hn logiques

- Implémenter Schema.org pour les rich snippets

Phase 3 (Mois 5-6) : Autorité et popularité

- Développer une stratégie de netlinking éditorial

- Créer du contenu « linkable » (études, infographies, guides experts)

- Auditer et nettoyer les backlinks toxiques

- Renforcer l’E-E-A-T (biographies auteurs, sources, transparence)

Maintenance continue : surveiller Search Console, mettre à jour le contenu ancien, surveiller les concurrents, tester et optimiser (titres, meta descriptions, structure).

Erreur à éviter : vouloir tout optimiser simultanément. Concentrez-vous sur les quick wins (optimisations rapides à fort impact) avant les chantiers complexes.

Le SEO en 2026 récompense les sites qui placent l’utilisateur au centre. Satisfaction de l’intention, expérience fluide, expertise démontrable : ces trois piliers surpassent toutes les techniques de manipulation. Commencez par créer de la valeur réelle, puis optimisez pour la rendre visible.

Prochaine étape concrète : auditez votre site avec Google Search Console, identifiez les 3 problèmes les plus critiques (technique, contenu ou popularité), et corrigez-les avant de passer au reste. L’action progressive bat la perfection paralysante.